token正式命名为“词元”,token到底是个啥?

最近几天,不少人第一次在许许多多的媒体里看见了这个词。不是流量,不是算力,也不是参数,而是一个原本更常出现在程序员聊天记录和大模型后台里的词——token,也就是“词元”。

01

一夜之间,

token怎么就成了“词元”?

“词元”被正式定义。图源于网络

值得注意的是,在人民日报等公开报道里,它被明确写成了“词元”;在国新办发布会上,国家数据局局长也直接说出了“Token,也就是词元”这句话。一个技术圈常用的英文词,正在以中文名字进入更广泛的公共表达。

为什么这件事值得关注?因为一个概念一旦被大众媒体稳定使用,就意味着它不再只是圈内黑话,而是开始成为普通人也会频繁遇到的公共词汇。以前大家刷到 AI 新闻时,看到 token 往往会直接跳过;现在,“词元”这个译法把它拉近了。它不像一个遥远的英文术语,更像一个可以被理解、可以被讨论、也可以被拿来解释现实世界的新名词。

看似聊天,背后却是词元计算。图源于网络

问题随之而来:这个听起来像是AI时代的“货币”单位的词元,到底是什么?它为什么突然这么重要?它跟我们平时说的字、词、句子,到底是什么关系?很多人以为自己只是在和 AI 聊天,实际上在模型眼里,这整个过程都在围绕词元展开。

02

一句话解释,

词元到底是个啥?

最直接的答案是,token,也就是词元,是大模型处理语言时使用的基本单位。它不是整句话,也不总是一个完整的词,更不等于字数。人类看见的是一段完整表达,模型接收到的却是一连串被切开的信息小块。模型不会像人那样“直接读懂一句话”,它需要先把语言拆分,再把这些拆分后的部分转成数字,最后才能继续计算。

如果把人类语言比作一条长长的项链,那词元就像项链上的珠子。你看到的是整体的光泽和形状,模型处理的却是每一颗珠子的顺序、位置和关系。它并不先理解“意义”,而是先处理“单位”。这就是为什么词元是大模型世界里最基础、也最关键的那把尺子。

你看到的是一句话,模型看到的是一串词元。图为AI创作

换个更生活化的比喻也许更好理解。我们点外卖时,平台不会按“我现在有点饿”来计算订单,它会按份数、菜品、重量、地址这些可处理的单位来组织系统。模型面对语言也是一样。你输入的是问题、情绪和需求,模型真正处理的却是一个个可以统计、可以编码、可以运算的词元。

它不是“字”,也不是“词”,更不是“句子”。

很多人一看到“词元”这个中文译名,就会自然地把它理解成“词”。但这恰恰是最容易产生误会的地方。词元并不严格等于语文课本里的“词”,也不稳定对应某个汉字,更不是一整个句子。它是机器为了处理语言而切分出来的一种计算单位。

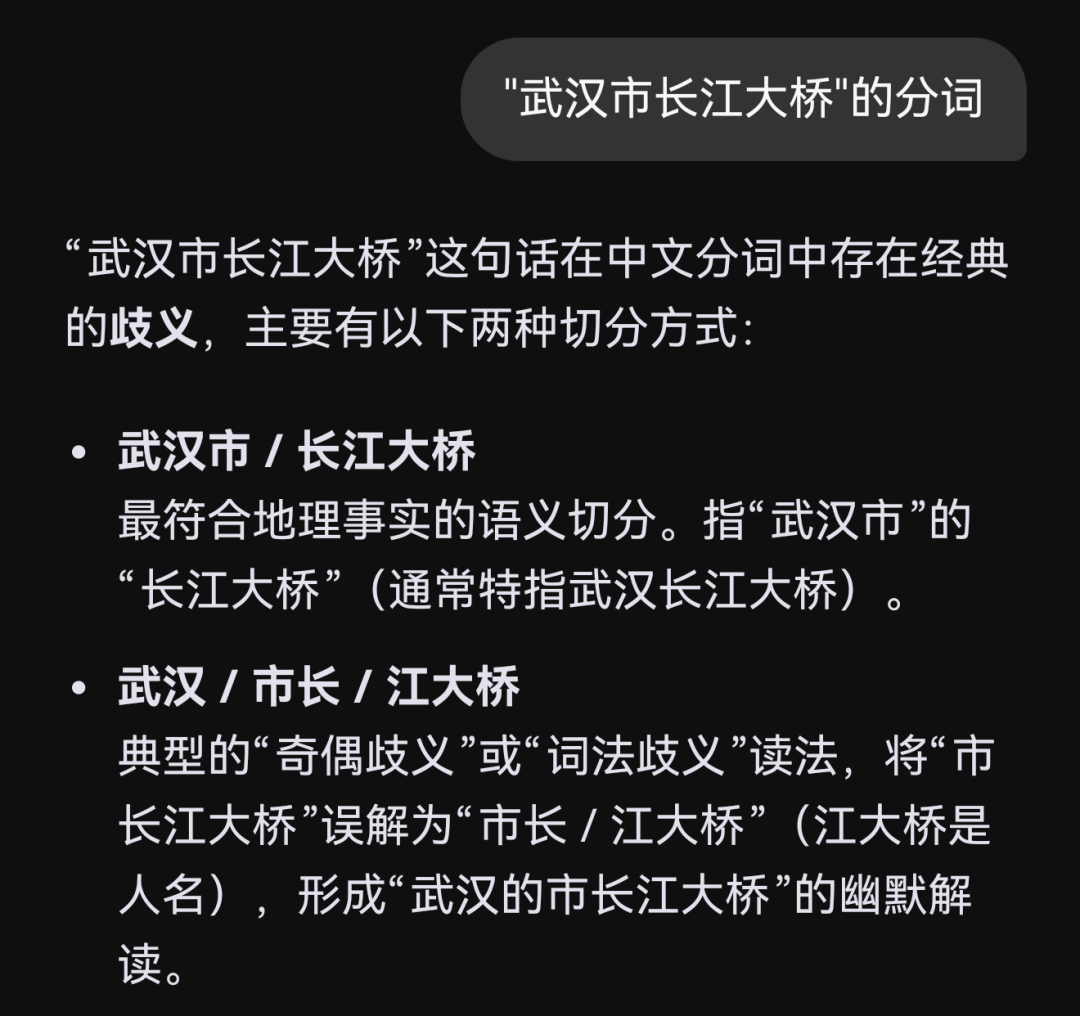

词元不是整句,也不稳定等于一个词。图源于网络

有时候,一个词元可能只是一个字符;有时候,它可能是一整个常见词;还有时候,它只是一个词的一部分。空格、标点、前后搭配,都会影响切分结果。也就是说,词元不是语言天然长出来的边界,而是模型为了更高效地处理语言,主动“切”出来的颗粒。

这件事非常重要,因为它会直接影响我们对“token 数量”的理解。你不能把 token 简单换算成“多少个字”或者“多少个词”。同一句话,换一个模型,词元数量可能就变了。因为不同模型背后的 tokenizer,也就是词元切分器,并不完全相同。人类共享的是语言,模型共享的却未必是同一套切法。

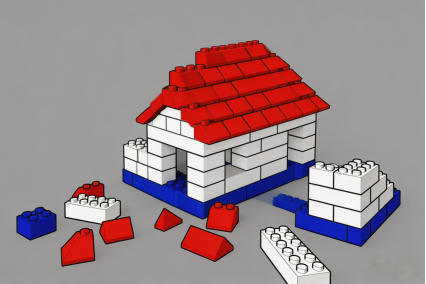

词元像积木,一样大的物体,可以根据不同的定义,拆解成不同的元件。图源于网络

03

模型为什么一定要

先把话“切一刀”?

原因说穿了并不神秘:模型并不真正认识文字,它认识的是数字。对我们来说,文字本身携带意义;对机器来说,文字只是符号。要让模型处理语言,必须先把这些符号转成编号,再让模型在编号之间建立关系。词元就是这个翻译过程中最关键的一层。

所以,大模型理解一句话的大致流程并不是“看见文字=立刻懂了”,而更像“切分语言—映射编号—进行计算—生成新编号—再还原成文字”。从这个角度看,模型不是在直接阅读人类语言,而是在处理一条条编号序列。文字是我们看到的外衣,词元和编号才是模型真正工作的内部形态。

和其它计量单位作用相似,词元是AI 时代的重要“计量单位”。图源于网络

如果你愿意把它想象得更具象一点,tokenizer 就像海关安检机。人类说出一句完整的话,进门时先被拆包、扫描、分类、编号,然后才进入系统内部流转。你在外面看到的是“我说了一句话”,模型内部发生的却是一场高密度的信息物流。

今天人人都开始谈论词元,因为词元已经不只是技术细节,而是越来越像 AI 时代的基础计量单位。你和模型聊一次天,会消耗输入词元;模型给你回一段话,会产生输出词元;上下文越长、材料越多、任务越复杂,词元消耗往往也越高。于是,速度、成本、上下文容量、服务能力,最后都会和词元挂钩。

AI运用词元的基本原理。图为AI生成

这也是为什么,国家数据局会把词元描述为既可计量,也可定价、可交易的单位。一个概念一旦同时进入技术语言、产业语言和媒体语言,就说明它已经不仅仅是工程师内部的术语,而是正在成为商业和公共讨论中的共同语言。简单说,词元之于大模型,有点像度数之于电表、流量之于手机套餐、公里数之于网约车。你平时可能不盯着它看,但一旦涉及性能、费用和规模,它立刻变成关键数字。

04

为什么中文语境下,

“词元”尤其值得理解?

在英文里,很多人会自然把 token 联想到 word,也就是“词”。但中文并不是按空格天然分词的语言,汉字、词语、短语和语境之间的边界都更灵活。因此,如果简单把 token 理解成“单词”,在中文场景下反而更容易误解。

这也是“词元”这个译法的一个妙处。它没有把 token 硬塞进已有的语法概念里,而是保留了一点技术感,同时又给普通人留出了理解空间。它在字和词之间,在语言学概念和计算概念之间,搭起了一座桥。你一看就知道,它大概和“词”有关,但又不是传统意义上的词。

更进一步说,很多主流的词元化方法,本来就不是按传统词典那样死板切分,而是采用子词策略。常见表达尽量整体保留,罕见表达再拆得更细。这样既能控制词表规模,又能兼顾表达能力。对于中文这种没有天然空格的语言,这种策略尤其关键。

AI对语言的转化。图源于网络

理解词元,其实是在理解 AI 到底怎么‘读’你的话。很多人觉得 AI 神秘,一个重要原因是我们总是从结果去看它。它会聊天、会写作、会总结、会翻译,于是大家容易把它想象成一个藏在屏幕后面的“聪明大脑”。但如果你从词元这个入口重新看,大模型立刻就会变得更具体。它不是先有灵感,再给出答案;它是在大量词元之间不断计算下一步最可能出现什么。

这并不会削弱 AI 的神奇感,反而会让我们更真实地理解它。你会明白,模型看起来像在和你自然交流,本质上却在完成一场高度精密的语言运算。你看到的是话语的流动,模型经历的是词元的排布、映射与生成。你感受到的是“它好像懂我”,模型内部处理的却是“这些词元在上下文里如何彼此关联”。

对普通人来说,理解这一点很有价值。因为未来越来越多的 AI 产品说明书、服务计费、性能指标、上下文限制、平台公告,都会不断提到“词元”这个单位。它很可能会像曾经的“流量”“像素”“带宽”一样,慢慢成为数字生活里必须认识的新词。

说到底,词元让我们看见了 AI 的底层节奏。

如果用一句话收束全文,答案可以是这样的:词元是人工智能把人类语言翻译成机器可处理形式时所使用的基本单位。它一头连着文字,一头连着数字;一头连着理解,一头连着计算;一头连着技术原理,一头连着商业现实。

理解词元,就是理解 AI 如何真正“读”你的话。图源于网络

所以,下次再听到“这个模型很费 token”时,你完全可以把它理解得更准确一些:不是它“很费词”,而是它在大量消耗机器处理语言所需的最小计算单位。你看到的是一句完整的话,模型面对的却是一串可以分割、编号和运算的词元。

而“词元”这个中文名字之所以重要,也正因为它让更多人第一次有机会用中文、用日常经验,去理解大模型世界里最基础却最关键的一块砖。你并不一定要学会训练模型,但只要理解了词元,就已经摸到了 AI 时代语言计算的门把手。

作者:亦山春晖